비회원

주식

0

129

0

0

2023.08.25 07:26

디지타임즈 "AI와 반도체 황금기" 심포지엄 주요 내용 요약

대만 디지타임즈에서 지난 주 개최한 "AI가 반도체를 황금기로 안내할 것인가?" 심포지엄에서 메모리 위주로 핵심적인 내용을 정리해 봄.

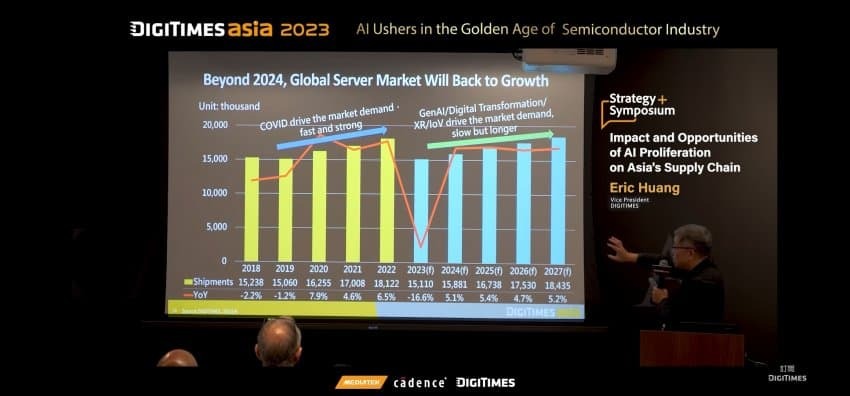

글로벌 서버 출하량은 코로나19 시기 언택트 붐으로 인해 매우 빠르고 강하게(Fast and Strong) 성장했다. 그 기저 효과와 더불어 생성 AI 붐으로 빅테크들이 값비싼 AI 서버에 투자하느라 일반 서버 구매가 감소하여 2023년 전체 서버 출하량은 -16.6% 역성장했다. 그 이후 생성형 AI와 생성형 AI에서 파생되는 어플리케이션 실행을 위해 전체 서버 출하량은 5년 이상에 걸쳐 점진적이지만 지속적으로(Slow, but Longer) 계속 성장할 것이다.

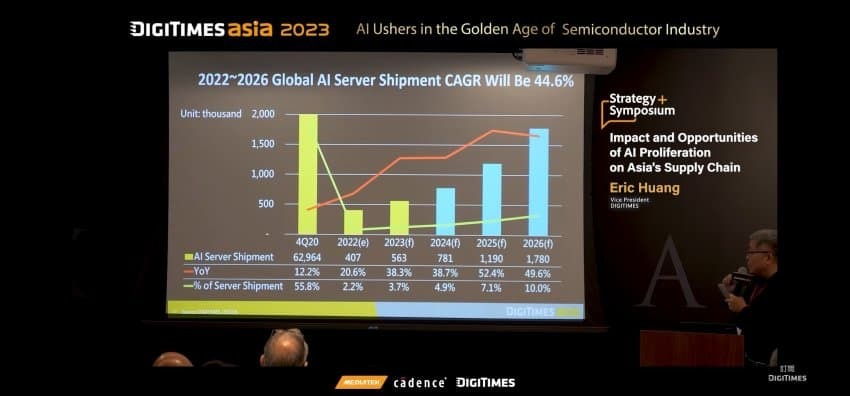

글로벌 AI 서버 출하량은 2026년까지 CAGR 44.6% 성장할 것이며, 전체 서버 출하량에서의 비중도 올해 3.7%에서 2026년에 10.0%까지 상승할 것이다.

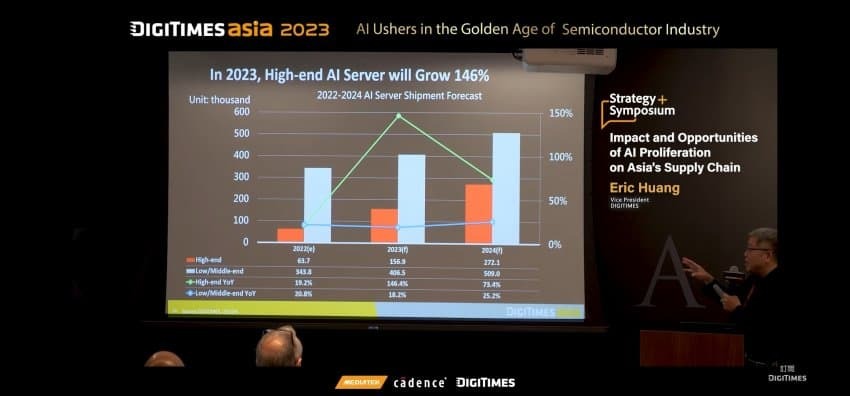

특히 AI GPU나 가속기를 탑재한 High-end AI 서버 출하량은 올해 146%, 내년 73.4% 성장해서 전체 AI 서버 출하량에서의 비중이 35%(=272.1/(272.1+909.0))까지 상승할 것이다.

PS. AI 서버는 일반 서버 대비 디램 탑재량이 훨씬 더 증가함. 특히 High-end AI 서버는 거의 8배 증가함. 또한 그 디램 대부분이 HBM처럼 고부가가치 고용량/고사양 제품임. 단순 서버 출하량만 보면 25년까지도 21년 수준을 회복하지 못하지만, AI 덕분에 서버 당 탑재하는 디램의 용량과 가격이 21년 대비 훨씬 더 증가함.

특히 HBM만 놓고 보면 GPU당 HBM 탑재량 증가가 없이 단순 High-end AI 서버 출하량 증가만으로도 올해 HBM 출하량이 거의 YoY 146% 증가한다는 뜻임. 그런데 AI GPU 세대가 업그레이드 될수록 다음 버전의 HBM이 탑재량도 1.5~2.0배 이상 증가한다는 점을 감안하면 내년에도 HBM 출하량은 거의 2배 이상 증가할 것으로 보임.

AI 서버 서플라이 체인 요약

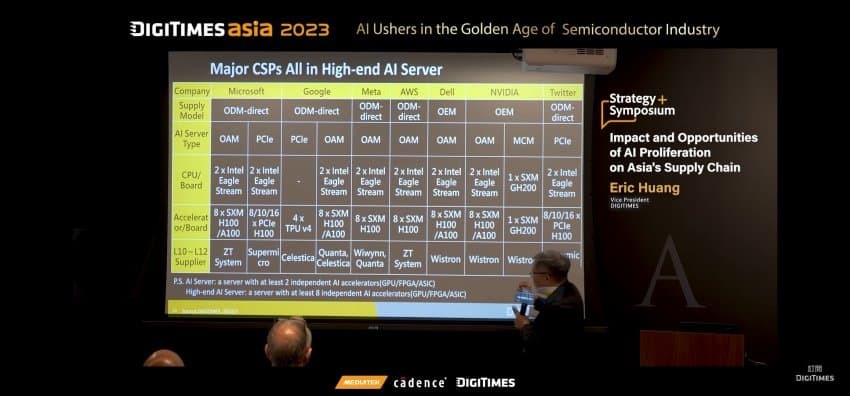

빅테크 업체별 High-end AI 서버 구성

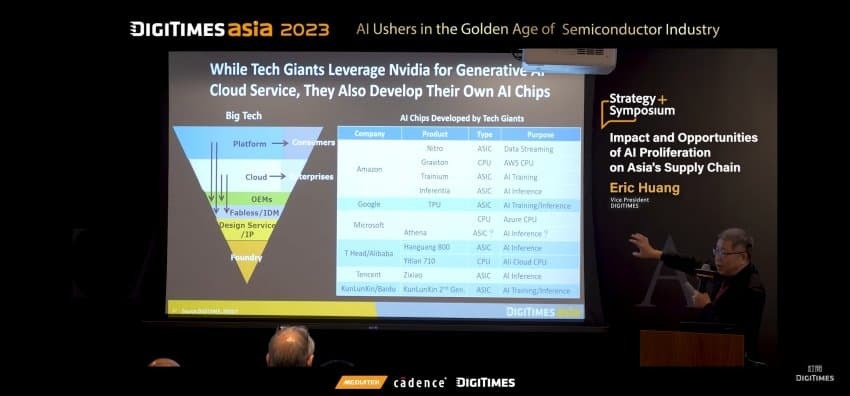

빅테크들은 엔비디아 AI GPU를 앞다퉈 사재기하고 있지만, 동시에 그들만의 독자적인 AI 반도체를 만들려고 노력하고 있다. 즉, 엔비디아에 있어 빅테크들은 주요 고객사이지만 향후 잠재.적인 경쟁자이기도 하다.

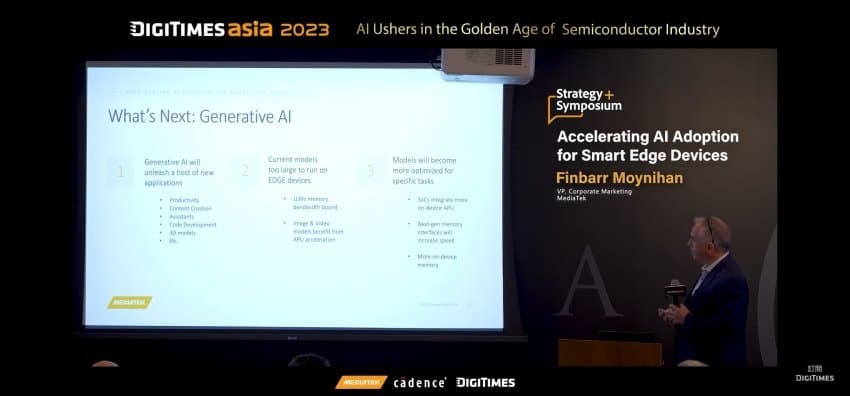

현재의 생성형 AI 모델은 엣지 디바이스에서 실행하기에는 너무 거대하고 무겁다. AI 모델은 앞으로 점점 더 특정 업무에 맞게 최적화될 것이다. 이를 위해서는 차세대 메모리와 온 디바이스 메모리 탑재량 증가가 필요하다.

- dc official App